![图片[1]-Yann Lecun :开源,LLM的局限性、AGI 和人工智能的未来-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0311%2F6d5bcb46j00sa5zci001xd200u000gwg00it00al.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

本文为1194字,建议阅读3分钟

![图片[2]-Yann Lecun :开源,LLM的局限性、AGI 和人工智能的未来-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0311%2F4fe0d96bj00sa5zcj00hcd200u000g7g00it00a5.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

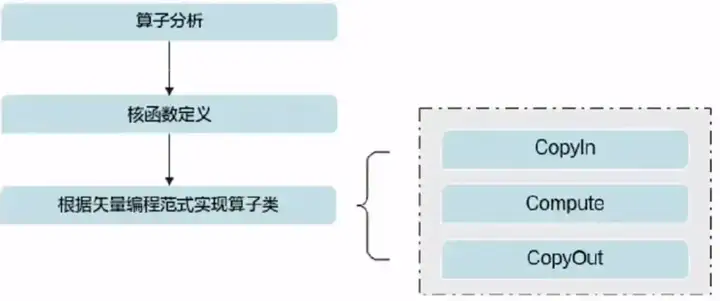

图灵奖获得者,Meta 首席科学家 Yann LeCun 最新接受 Lex Fridman 播客采访,整个采访2小时38分,探讨了一大堆内容,讨论了:开源的重要性、LLM 的局限性、为什么人工智能末日论是错误的,以及通向通用人工智能的道路等话题,非常重要!!! 能听到与现有大火的OpenAI AGI道路不同的思考和认识是非常重要的!!包括但不限于以下内容:

– 大型语言模型的局限 – 双语能力与思维模式 – 视频内容预测 – JEPA(联合嵌入预测架构) – JEPA 与大型语言模型的较量 – DINO 与 I-JEPA – V-JEPA – 分层规划策略 – 自回归型大型语言模型 – AI 的幻觉现象 – AI 的推理能力 – 强化学习原理 – 觉醒的人工智能 – 开源运动 – 人工智能与意识形态 – Marc Andreesen

– Llama 3 项目 – 通用人工智能(AGI)的探索

– 对AI末日的担忧 – Joscha Bach

– 人形机器人的发展 – 对未来的美好期待

完整文字记录:https://lexfridman.com/yann-lecun-3-transcript

视频地址:https://www.youtube.com/watch?v=5t1vTLU7s40

以下是访谈中的核心议题摘要:

-

大型语言模型(LLMs)的局限性:LeCun指出LLMs虽然在许多抽象任务上表现出色,但在描述如“如何走下楼梯”或“从椅子上站起来”这类涉及精确肌肉控制的低级动作指令方面存在局限。他强调,物理世界的互动需要比人类语言所能表达的更高带宽的经验,这促使人们考虑结合LLMs与诸如JEPA(Joint-Embedding Predictive Architecture)这样的架构,后者能够提升表示的抽象层次而不去尝试重建情境的具体细节

-

JEPA与LLMs对比:JEPA是为了解决LLMs无法处理低层次动作链接到高层次推理的问题而提出的,比如从制定宏观计划(例如预订机票)到执行微观动作(访问网站)。LeCun认为LLMs确实可以帮助处理高层次计划,但对于如何将这些计划与底层行动联系起来,就需要借助JEPA这样的技术

-

AI幻觉现象:LeCun对自回归LLMs持一定的怀疑态度,他认为虽然LLMs可以通过已知场景训练来回答某些问题,但在面对未曾训练过的复杂情况时可能会产生非事实性的、即“幻觉式”的答案

-

强化学习(RL)的运用与局限:LeCun并不主张完全放弃RL,但建议限制其使用,因为RL在样本效率上非常低效。正确的做法首先是让AI系统通过观察和少量交互学习世界模型和良好表示,然后根据这些表示来指导行动。然而,在实际操作中发现模型或目标函数不准确时,就需要用到RL来调整世界模型或批评器

-

AI在现实世界中的应用难度:LeCun举例说明即使LLMs可以提供制造化学武器或火箭发动机的详细步骤,但真正将其转化为现实世界中的具体操作仍然需要大量实物操作经验和专业知识,这是LLMs无法提供的

-

开源与Llama系列进展:在开源领域,LeCun对即将发布的Llama 3表达了期待,认为后续版本会有更大规模、更好性能、更多模态的特点,最终目标是研发出具备真正理解和实施计划能力的AI系统

-

分层规划与AGI的未来:访谈还涵盖了AI的分层规划问题,讨论了当前尚未有人知道如何训练一个系统来学习适合多层次表示以支持分层规划工作。LeCun认为在从高层次战略规划(如跨国旅行)到低层次动作执行的过程中,AI需要有动态重规划的能力,而这正是当前AI研究的重要挑战之一

结语

期待Llama 3早日发布,看看Yann Lecun主推的Meta的AGI方案到底怎么样,其实现在最火的就是OpenAI主推的AGI方案,大家看到了ChatGPT,sora 一个接一个震惊世界的产品,Google也在主推自己的AGI方案,但是最近翻车有点严重,可惜了,曾经Google人工智能当之无愧的老师

且看吧,OpenAI vs Meta vs Google,AGI谁会笑到最后?