刚刚,GPT-4o mini版迎来“高光时刻”——

登顶了lmsys大模型竞技场,和满血版并列第一,还把Claude 3.5甩在了身后。

![图片[1]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fb6fc086aj00sh4a6m002jd000u000odm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

不同于一般的数据集测评,大模型竞技场是用户自己出题、用脚投票的结果,无法通过“刷题”来走捷径,因此更为真实。

这个成绩一出,连CEO奥特曼都激动起来了:

面对评估成绩,我们本来是尽量矜持的,但是看到GPT-4o mini表现和满血版一样,价格却只有1/20,内心还是很激动。

![图片[2]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F147ac184j00sh4a6m0019d000u0008sm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

网友看到之后表示OK,但更关心的还是GPT-4o发布会上演示的“Her”到底啥时候上线。

![图片[3]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F3dd77c1aj00sh4a6m000rd000u0006wm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

与此同时,OpenAI也送来了另一个好消息,将为开发者送出福利——

GPT-4o mini的微调将逐步开放,目前已开放给tier 4和tier 5用户,然后会陆续扩展范围。

而且从即日起到9月23号,每天都能免费使用2百万的训练token。

![图片[4]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F48c73a1bj00sh4a6m0018d000u000bam.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

![图片[5]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](http://cms-bucket.ws.126.net/2019/10/14/c66f41ca219849a987b74f5b496dd9db.png)

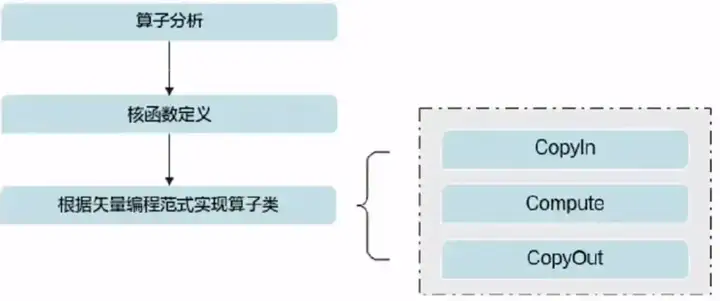

mini与满血版平起平坐

经过80多款模型上百万轮的1v1比拼,GPT-4o mini在lmsys榜单上的成绩与满血版只差7分。

按照lmsys榜单的排法,这7分的差距没有影响名次,把两个型号算作了并列第一。

紧随其后的是Claude 3.5和Gemini家族,还有GPT-4的另外两个版本。

![图片[6]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F94c88726j00sh4a6m001yd000u000i3m.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

如果我们查看GPT-4o mini的原始数据,会发现它0.6的平均胜率仅次于满血版本。

![图片[7]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fe8eccad5j00sh4a6m002id000u000l3m.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

单独看两者比拼的结果,同样是打得不相上下。

![图片[8]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fca70818dj00sh4a6m004ad000u000qxm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

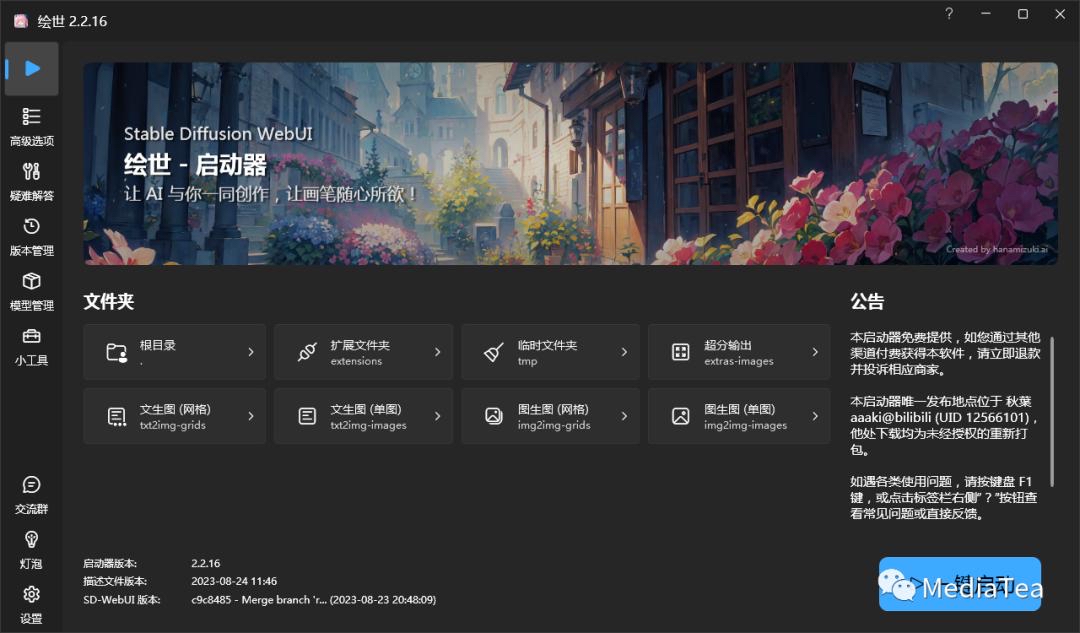

之所以lmsys的成绩受到关注,在于它拥有一套独特的比拼方式——

不用数据集,而是让用户自己出题,随机拉两个模型1对1battle,然后选择哪个模型表现更好。

在给出选择之前,模型是匿名的,用户也不知道是哪两个模型正在比拼,如果模型自己说漏嘴则投票无效。

![图片[9]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fa2291986j00sh4a6m000rd000u000nzm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

这样得到的分数更加真实,既避免了“刷题”获取虚高分数的可能,也更加接近用户体验。

这个大模型竞技场,最近还登上了机器学习顶会ICML2024。

![图片[10]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F2032b3a6j00sh4a6m003gd000u000y4m.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

而且,lmsys的评测也非常受OpenAI的青睐,GPT-4o mini正式上线之前的早期版本,就曾化名为gpt-mini在其中打榜。

当时就已经排行第4,和GPT4-Turbo处在同一水平。

![图片[11]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F5d5c6c8ej00sh4a6m003id000u000tvm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

更早一些,GPT-4o上线之前也是化名gpt2-chatbot,在lmsys上搞起了测试。

![图片[12]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2F5c37ef63j00sh4a6m001ad000u000gzm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

不过也有人提出质疑,表示虽然GPT-4o mini表现确实很好,但是要说它超过了Claude 3.5 sonnet就有些言过其实了。

![图片[13]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fdec1a44cj00sh4a6m000vd000u00073m.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

有人更是直言,lmsys方法的完善性已经开始瓦解,需要做出改变,否则将不再是一个有用的测试基准。

![图片[14]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fd0217b04j00sh4a6m000ud000u0007bm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

![图片[5]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](http://cms-bucket.ws.126.net/2019/10/14/c66f41ca219849a987b74f5b496dd9db.png)

“小模型”也卷起来了

mini版本的推出,主打的就是一个性价比。

每百万输入/输出tokens,价格分别为15美分和60美分(约1.09/4.36人民币),甚至还不到3.5 Turbo的一半。

![图片[16]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fc5073e70j00sh4a6m0017d000u000frm.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

如果和两年前GPT-3的text-davinci-003版(当时最好的模型)相比,价格更是下降了99%。

而且除了把小模型开放给用户,OpenAI还搞出了新鲜玩法——

在“超级对齐”团队的一篇遗作中,使用了参数量为大模型千分之一或百分之一的小模型,来对大模型进行优化。

实验中,大小两个模型相互“博弈”,大模型需要不断优化调整自己的输出,让小模型相信自己说的是真话。

在这个“博弈”的过程中,大模型的能力得到了提升,在精度没有明显损失的情况下获得了大幅度的可理解性提升。

![图片[17]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Fbc9938d1j00sh4a6m0016d000u000dym.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

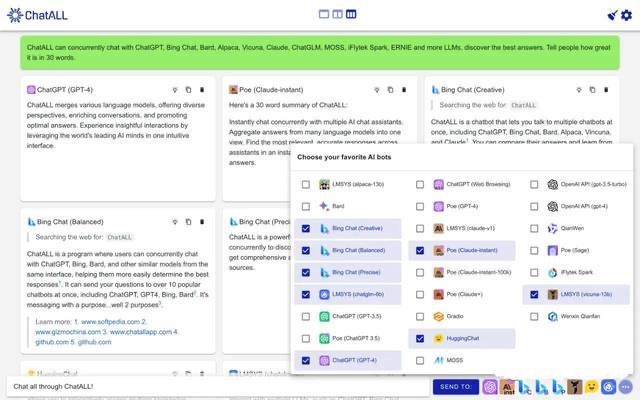

除了OpenAI,其他公司也都纷纷搞起了小模型。

比如在GPT-4o mini之前,谷歌和Anthropic就分别推出了Gemini Flash和Claude 3-Haiku。

甚至可以说,GPT-4o mini就是OpenAI对两家的反击,无论是性能还是价格都超越了这两个模型。

![图片[18]-GPT-4o mini登顶大模型竞技场,奥特曼:两个月内微调免费-开放智能](https://nimg.ws.126.net/?url=http%3A%2F%2Fdingyue.ws.126.net%2F2024%2F0724%2Ffddf9422j00sh4a6m000pd000k000f3m.jpg&thumbnail=960x2147483647&quality=75&type=jpg)

在GPT-4o mini发布的同一周,抱抱脸Hugging Face,以及“欧洲OpenAI”Mistral都相继推出了小号模型。

甚至苹果也推出了自己的7B模型,而且一次性开源了全部训练过程和资源。

总之,在性能足以满足使用需求的前提下,小模型无疑是一种更经济实惠的选择。

同时,更小的规模也意味着有可能在端侧运行,在隐私保护等方面显现出优势。

这样就不难理解,“小”模型为什么也越来越卷了。

参考链接:

[1]https://x.com/sama/status/1815877987696533897/

[2]https://x.com/OpenAIDevs/status/1815836887631946015